蘋果與瑞士洛桑聯邦理工學院(EPFL)合作,在 Hugging Face Spaces 平台公開展示「Massively Multimodal Masked Modeling」(4M)模型。這款模型 7 個月前開源釋出,現在透過公開平台展示技術,給予更多開發者接觸這項技術的機會。

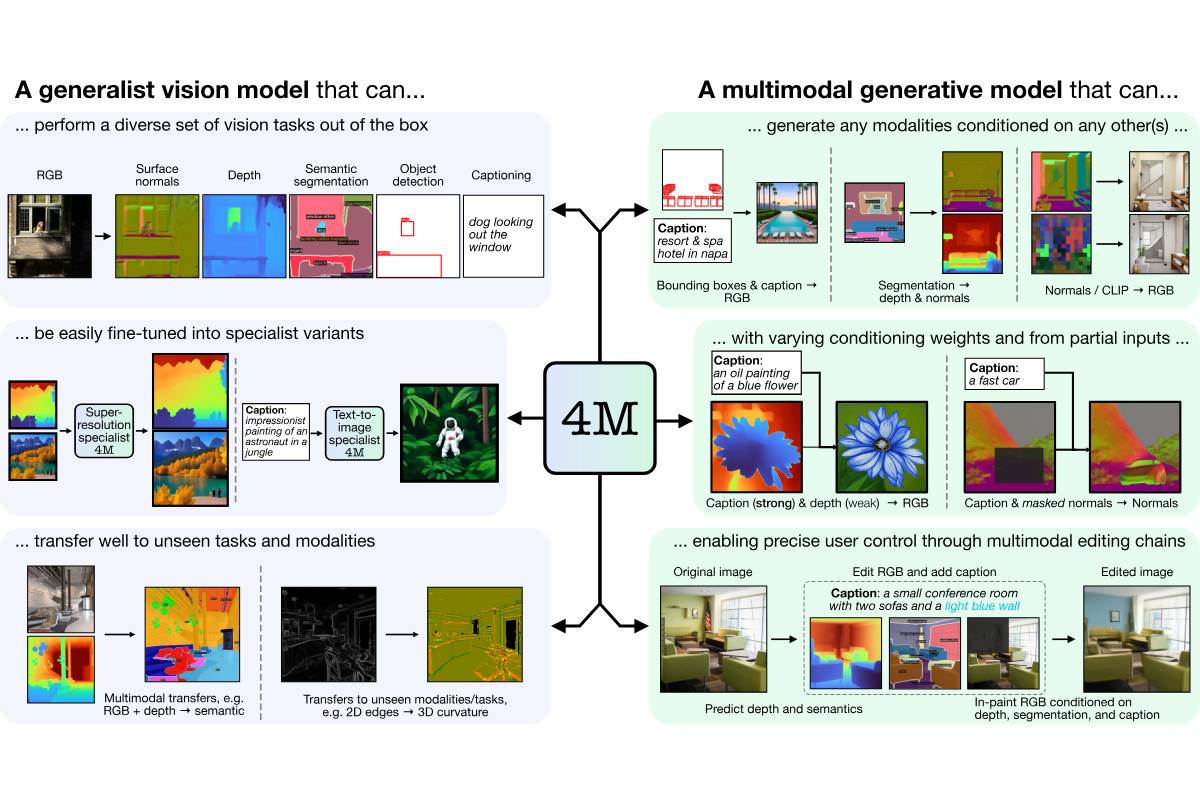

4M 是一種多功能 AI 模型,能夠多模態處理和生成影像內容。使用者能與 AI 系統互動,根據文字描述建立圖像、執行複雜物件偵測,甚至以自然語言操控 3D 場景。

4M 與眾不同之處在於,它針對不同模式的統一架構,這種方法可能在蘋果生態系帶來連貫和通用的 AI 應用程式。想像一下,未來 Siri 能夠理解並回應涉及文字、圖像及空間資訊的複雜查詢,或 Final Cut Pro 根據自然語言指令自動生成和編輯影片。

4M 暗示蘋果的 AI 野心,這款模型以自然語言操控 3D 場景的能力,可能對 Vision Pro 功能迭代和蘋果 AR 進展帶來令人興奮的長遠影響。

▲ 多模態模型 4M 的框架。(Source:Massively Multimodal Masked Modeling)

蘋果一直穩步提升自己的 AI 能力,值得一提的是,透過公開平台展示技術,透露出蘋果傳統的秘密研發方式產生重大轉變。以開源 AI 平台提供存取 4M,不僅展現蘋果 AI 實力,更能吸引開發者興趣,進一步參與蘋果生態系。

(首圖來源:shutterstock)